En contrepoint, promu le cadre d’un pouvoir fort, n’hésitant pas à vanter des figures historiques « inspirantes » comme Thomas Sankara ou Che Guevara et à ériger la Russie et la Chine « comme des exemples à suivre ». Malheureusement, les exemples ne manquent pas.

Algorithme de recommandations : de quoi parle-t-on ?

Les géants du Web (Facebook, Instagram, TikTok, YouTube, Amazon, X….) ont inventé des méthodes inédites pour séduire un visiteur par le biais d’algorithmes de recommandation qui créent des bulles de filtres. L’algorithme de recommandation est une suite de calculs qui analyse et sauvegarde tout le contenu d’un site ou d’un réseau social. C’est un outil d'intelligence artificielle conçu pour prédire et suggérer des produits, services ou informations aux utilisateurs. Son objectif est d'analyser leurs préférences et comportements antérieurs. Il effectue un tri sur différents critères : historique de navigation, genre de films que vous aimez (action, comédie,… ), les thèmes et personnes que l’utilisateur suit le plus sur tel ou tel réseau social, abonnement à un fil d’actualité , like, clics, etc. Le rôle de l’algorithme de recommandation consiste à mettre en correspondance (« matching ») les contenus avec ceux de l’utilisateur.

Quels sont les principaux algorithmes de recommandation ?

Il existe plusieurs algorithmes de recommandation comme User-based qui utilise une approche comparable au bouche-à-oreille ; Item-based utilise, lui, un profil d’article qui est constitué de la liste des utilisateurs ayant lu/aimé tel ou tel article. Son concurrent, Content-based analyse dans un premier temps un ensemble de contenus sans prendre en compte les utilisateurs puis, dans un second temps, détecte les similarités entre les contenus à des fins de recommandation. Par exemple Content-based identifie le sujet d’un contenu en répertoriant tous les mots d’un article de presse puis en comparant tous les mots de l’article analysés aux autres articles. Plus un article aura un nombre de mots similaires, plus ces articles seront considérés comme « proches » permettant ainsi de détecter les sujets identiques ou similaires et d’en déduire des recommandations pour le lecteur…

en contrepoint, promu le cadre d’un pouvoir fort, n’hésitant pas à vanter des figures historiques « inspirantes » comme Thomas Sankara ou Che Guevara et à ériger la Russie et la Chine « comme des exemples à suivre ». Malheureusement, les exemples ne manquent pas.

Bulles de filtre : « Malbouffe informationnelle »

En utilisant toutes ces données collectées sur les utilisateurs, les algorithmes déterminent les contenus qui leur seront accessibles. Se crée ainsi une bulle de filtres qui correspond, selon la définition d’Eli Pariser président de l’association politique MoveOn.org et co-fondateur de l’ONG Avaaz.org, à « l’état dans lequel se trouve un internaute lorsque les informations auxquelles il accède sur Internet sont le résultat d’une personnalisation mise en place à son insu ». Autrement dit, chaque utilisateur navigue dans une version unique du web et des réseaux sociaux, adaptée à ses préférences, dans une sorte de bulle personnalisée. Selon la théorie d’Eli Pariser, les bulles de filtres pourraient avoir des conséquences négatives sur les utilisateurs du Web et des réseaux sociaux. En effet, on a longtemps cru qu’Internet permettrait à tous les individus d’être égaux dans leur rapport à l’information, les ouvrirait sur le monde en abolissant les distances et en rendant les informations accessibles à tous.

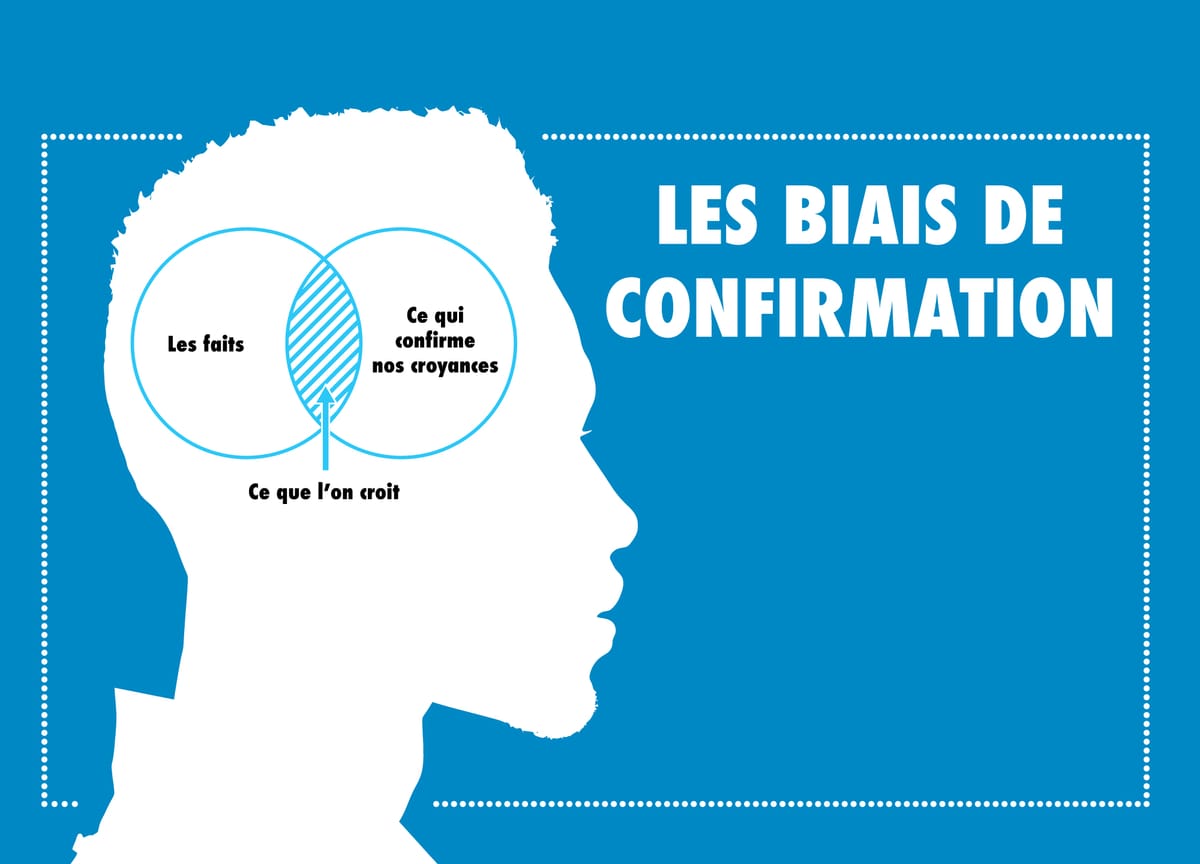

Or le fait que les algorithmes proposent un contenu personnalisé va à l’encontre de cette vision universelle. En fait, ils restreignent le champ de réflexion du l’utilisateur jusqu’à en modifier sa représentation du monde. En plus, de manière assez paradoxale, ces bulles de filtres qui isolent les utilisateurs tendent à homogénéiser l’identité sur Internet. Eli Pariser l’illustre très bien à travers le biais psychologique du présent. Il s’agit ici de la différence qui existe entre ce à quoi un individu aspire et ce qu’il fait réellement. En ne faisant pas la différence entre les impulsions d’un individu et ses véritables intérêts, les filtres tendent à favoriser les contenus qui demandent moins d’efforts. Au lieu d’un régime d’informations variées, ces filtres favorisent la « malbouffe informationnelle », explique Pariser. En résumé, l’utilisateur développerait une propension à rejeter les points de vue Hcontradictoires, renforcerait son entre-soi idéologique et modifierait, inconsciemment, ses perceptions sur la réalité sociale.

Algorithmes de recommandation et désinformation

Certaines entreprises se sont appuyées sur ces algorithmes pour développer des opérations malveillantes, à l’insu des utilisateurs. Ainsi, en 2016, l’entreprise tunisienne de "cyberinfluence et d'intelligence digitale", Ureputation, avait monté l’Opération Carthage. Celle-ci consistait à créer sur Facebook et Instagram des centaines de faux comptes et pages voués à influencer les électeurs tunisiens et ceux de plusieurs pays d'Afrique francophone. Avec l’objectif de peser sur les élections présidentielles de nombreux pays notamment la Côte d’Ivoire, le Togo et bien sûr la Tunisie. Les comptes de Ureputation rassemblaient pas moins de 4 millions de personnes. Estimant que l’entreprise avait violé sa charte contre les interférences étrangères, le groupe Meta a supprimé 446 pages, 182 comptes Facebook, 96 groupes, 60 événements et 209 comptes Instagram. En mars 2018, c’est la société britannique de conseil Cambridge Analytica qui a récupéré, sans leur consentement, les données de dizaines de millions d’utilisateurs de Facebook pour tenter l’influencer le vote des électeurs en Afrique… Plus récemment, les juntes militaires du Mali et du Burkina-Faso ont diffusé sur les réseaux sociaux des fausses nouvelles visant à discréditer les démocraties. Elles ont, en contrepoint, promu le cadre d’un pouvoir fort, n’hésitant pas à vanter des figures historiques « inspirantes » comme Thomas Sankara ou Che Guevara et à ériger la Russie et la Chine « comme des exemples à suivre ». Malheureusement, les exemples ne manquent pas.

Comment se prémunir des algorithmes de recommandations

Des parades et des alternatives simples existent pour contrer les effets négatifs de ces algorithmes et de se défaire de ces bulles de filtres. La première et la plus efficace est de multiplier ses sources d’information et de les recouper. Il est donc très utile de s’abonner à des journaux fiables et de varier le contenu que l’on consomme en ligne. La deuxième est de suivre des pages qui vont à l’opposé de ses propres opinions, ce qui permet de déjouer les algorithmes et d’en apprendre plus sur des opinions opposées aux nôtres. Au final, cette alternative permet de vaincre certains biais cognitifs communs, notamment le biais de confirmation.

La troisième est d’initier et de former les jeunes générations à la vérification des faits (fact-checking) que ce soit au sein du système éducatif, associatif ou familial, grâce à quelques outils comme Africa Check (https://africacheck.org/fr) ou Alliance africaine de vérification des faits (https://fr.factcheck.africa/) .

Il est aussi possible de réduire son empreinte numérique grâce au kit Data Detox (https://datadetoxkit.org) et Tournesol (https://tournesol.app) Ces sites, parmi d’autres, contiennent un grand nombre de conseils, pour la plupart assez simples, qui visent à améliorer la vie privée et la sécurité en ligne des utilisateurs. Ces différents trucs permettent également de limiter le pouvoir des algorithmes. il existe aussi des logiciels chargés d’analyser différents « témoins de navigation » ou « cookies » afin de s’assurer qu’ils ne soient pas trop intrusifs dans leur collecte de données. Privacy Badger, Adblock, Ghostery et uBlock Origin en sont quelques exemples.L’enjeumajeurest de pouvoir conserver son propre libre-arbitre.