Les escroqueries sentimentales appelées également “arnaque à l’amour” existent depuis longtemps et font souvent la une des journaux. Ces escroqueries ne manquent pas d’exemples. Qu’il s’agisse des escrocs sur Tinder ou bien les escroqueries sur héritage, toutes ces fraudes ont un point commun : la dissimulation ! Nombreux sont ceux qui utilisent des photos de personnes réelles en se faisant passer pour elles afin de leur extorquer de l’argent.

Pourtant, tout récemment il a eu un cas, magistralement connu dans le monde entier, qui illustre parfaitement cette arnaque : c’est la déconvenue frauduleuse et sentimentale qu’a vécu Anne dans sa chair. Cette Francaise de 53 ans a été escroquée de 850 000 dollars par un faux Brad Pitt. La victime a raconté sa triste expérience sur la chaîne de télévision française TFI pensant que ce dernier était la vraie star internationale. Anne a expliqué les raisons pour lesquelles elle a transféré 850 000 dollars au faux Brad Pitt. Elle croyait qu’il souffrait d'une maladie rénale et qu'il ne pouvait pas accéder à ses comptes en raison de la procédure de divorce en cours.

Une affaire de famille

Dans cette histoire singulière, en février 2023, Anne aurait été approchée et contactée, via Instagram, par une personne qui se prétendait être Jane Etta (la mère de Brad Pitt). Cette fausse mère aurait dit à Anne que son fils « avait besoin d'une femme comme elle ». Le lendemain, le faux Brad Pitt est entré en scène et il a pris contact avec Anne en lui témoignant : « Ma mère m'a beaucoup parlé de vous ».

Avec le temps, ils ont commencé à nouer une “romance numérique” et sans le moindre soupçon, Brad Pitt a évoqué sa situation et a commencé à faire des demandes financières subtiles. Tout d'abord, il a essayé de lui envoyer des cadeaux de luxe mais, en raison de sa procédure de divorce avec l'actrice Angelina Jolie, il ne pouvait pas payer les droits de douane car ses comptes étaient gelés. Malgré certains doutes, Anne a fini par être convaincue en déclarant : « Chaque fois que je doutais de lui, il parvenait à les dissiper ». C’est ainsi qu’Anne a transféré la coquette somme de 9 000 euros pour des cadeaux imaginaires.

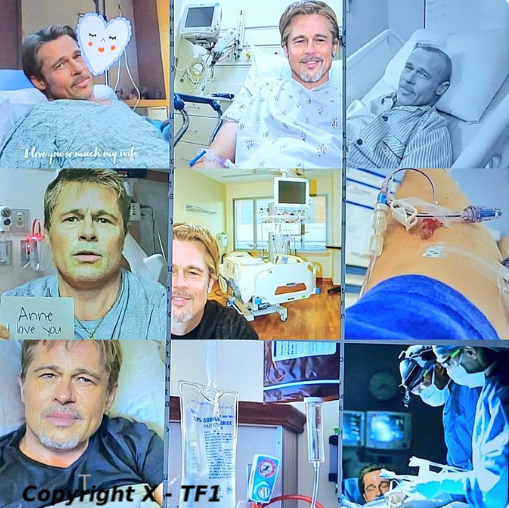

Puis, les demandes financières du faux Brad Pitt ont pris une autre nature lorsqu'il a demandé de l'argent pour financer son traitement contre son cancer du rein. Les escrocs ont alors envoyé à la victime des photos de Brad Pitt. Ces photos, générées par l'intelligence artificielle, présentaient l’acteur américain allongé sur un lit d'hôpital qui lui clamait son amour éternel. Elle a déclaré : « J'ai cherché ces photos sur l'internet mais je ne les ai pas trouvées, alors j'ai pensé que cela signifiait qu'il avait pris ces selfies juste pour moi ».

D’ailleurs, cette hospitalisation a renforcé son lien intime avec lui. Se remettant elle-même d'un cancer, Anne a eu l'impression de sauver une vie : « Je me suis dit que je sauvais peut-être la vie d'un homme ».

Attention au Deepfake !

C’est alors qu’Anne a rassemblé toutes ses économies, envoyant 830 000 euros à sa prétendue idylle qui lutte contre le cancer du rein. La fille d'Anne, alors âgée de 22 ans, a déployé tous ses efforts pour convaincre sa mère qu'il ne s'agissait pas du vrai Brad Pitt, la fille déclarant sur la chaine TF1 : «C’est très dur de voir à quel point ma mère était naïve». Peine perdue, Anne était totalement convaincue par les images générées par l'IA.

Toutefois, la relation a pris une autre tournure lorsque des photos de Brad Pitt et de sa nouvelle petite amie, Ines de Ramon, ont circulé sur les médias sociaux. La victime a été très perturbée mais les escrocs ont réussi a créé un faux article de presse dans lequel Brad Pitt parlait de sa « relation exclusive avec une personne si merveilleuse... prénommée Anne». Cette fausse publication a permis aux escrocs de regagner la confiance de la victime.

Après toutes ces turpitudes, Anne a réalisé que sa relation numérique avec le prétendu Brad Pitt était en réalité une pure usurpation. Elle a réussi à mettre un terme à cette relation sentimentale dévastatrice. Malgré cela, les escrocs ne reculant devant rien, ont tenté de lui soutirer encore de l’argent en se faisant passer pour un certain John Smith (agent spécial du FBI). Anne prit la décision de faire appel à la police dans le but de porter plainte. Désormais, la victime vit chez un ami. Sa vie est brisée et anéantie par les escrocs : « Toute ma vie se résume à une petite pièce avec quelques cartons. C'est tout ce qu'il me reste ». Dans sa détresse, elle a tenté de se suicider à trois reprises.

Cette histoire est devenue virale avec un retentissement mondial compte tenu de l’'importance de la somme d’argent usurpée mais aussi de la technique utilisée. La victime a fait l'objet de vives réactions, dont de nombreuses moqueries.

Le Toulouse FC, un club de football français, s'est moqué d'elle en postant dans un tweet, aujourd'hui effacé : « Bonjour Anne, Brad nous a dit qu'il serait au stade mercredi pour Toulouse-Laval. Et toi ? ». Netflix-France a profité de ce malheureux incident pour promouvoir des films avec Brad Pitt, en écrivant « quatre films à voir gratuitement avec (le vrai) Brad Pitt ».

Bien que de nombreuses personnes se soient moquées d’Anne, d'autres au contraire ont souligné l’utilité de son témoignage. Un post populaire sur X a relayé ce commentaire :

« Je comprends l'effet comique. Néanmoins, nous parlons d'une femme d'une cinquantaine d'années qui s'est fait arnaquer par des deepfakes et de l'IA. Songez à vos parents et grands-parents comment ils auraient agi dans de pareilles circonstances ! ».

Une tribune, publiée dans le journal Libération, qualifie Anne de lanceuse d'alerte : «Aujourd’hui, la vie est pavée de cyber-pièges... et les progrès de l'IA aggraveront ce scénario ». Il est certain que beaucoup de personnes ont éprouvé la même situation que celle d'Anne; Parfois la honte et la stigmatisation liées au fait de tomber dans ce type d’arnaque,empêchentles femmes âgées de témoigner.

Anne a également déclaré dans une émission populaire française qu'elle n'était pas « folle ou imbécile » tout en reconnaissant : « Je me suis fait avoir, je l'admets... c'est pour cela que j’ai souhaité témoigner, car je ne suis pas la seule ».

En effet, Anne n'est pas la seule a avoir eu cette mésaventure. Il s’avère que deux espagnoles ont également été victimes de l'escroquerie du « deepfake » de Brad Pitt. L'une ayant payé 175 000 euros. Quant à sa comparse, 150 000 euros lui a été subtilisés. Toujours dans ce meme genre de scénario, Nikki MacLeod, une conférencière écossaise à la retraite, a également été victime d'une fausse photo et de fausses vidéos utilisées pour lui soutirer 17 000 livres sterling. Cette femme de soixante-dix-sept ans, originaire d'Édimbourg, a déclaré : « Je ne suis pas stupide, mais cette personne a réussi à me convaincre que nous allions passer notre vie ensemble”. Les escrocs se sont attaqués à elle en exploitant sa solitude et ses fragilités causées suite à la perte de ses parents.

Comment les fraudeurs exploitent leurs victimes ?

Les médias sociaux ne sont pas à l'origine des fraudes amoureuses, mais l'ampleur de ses fraudes est due aux médias sociaux. Quelques clics suffisent pour joindre des personnes situées à des kilomètres et/ou dans différents pays. Ces escrocs ne se contentent pas de voler votre argent ; ils s'attachent à voler votre cœur en vous rendant d'abord incapable de résister à leurs exigences financières démesurées.

Selon le data spotlight , « près de 70 000 personnes ont signalé une escroquerie à l'amour et les pertes déclarées ont atteint le chiffre record de 1,3 milliard de dollars en 2022 ». Ces escrocs ne touchent pas le jackpot par hasard. Ils étudient leurs victimes et créent des personnages, ciblant principalement les personnes âgées qui ne maîtrisent pas forcément l'informatique. Ils exploitent leur solitude et leur vulnérabilité affective. Ils profitent de leurs émotions, de leur intelligence et surtout de leur argent. Les profils, de ces victimes, sont multiples mais ont souvent un point commun : ils ne pas maitrisent pas l’outil l'informatique.

Les escrocs s'efforcent de gagner la confiance de leurs victimes par une communication constante. Les fausses promesses et les modes conversationnels du type semi-interrogatoire, sont autant de ruses pour dominer habilement leurs victimes. Le premier contact est toujours établi via des plateformes numériques (principalement des applications de rencontre ou des plateformes de médias sociaux) avec des photos d'une personne attrayante. Une fois la communication faite, ils s'efforcent de gagner la confiance de leur victime potentielle, puis la font passer à une plateforme plus privée, généralement WhatsApp ou Telegram.

D’ailleurs, ces escrocs en ligne, ont toujours des raisons pour lesquelles ils ne peuvent pas rencontrer physiquement leur victime potentielle. Ils essaient de gagner du temps afin d'obtenir plus d'informations personnelles.

Ils disposent également de modèles d'escroquerie déjà existants qu'ils peuvent utiliser pour différents types de personnes en fonction des informations qu'ils ont pu recueillir. Par exemple, si une victime potentielle a déclaré avoir perdu un membre de sa famille, un ami ou un conjoint à cause d'un cancer, tôt ou tard, son ami en ligne sera atteint d'un cancer et aura besoin de son aide. Ayant perdu un être cher à cause du cancer, ces victimes cèdent à leurs émotions puis ensuite à leurs demandes. Cette spirale va jusqu'à épuiser leurs cartes de crédit, vendre leur maison et dépenser tous leurs fonds propres pour sauver leur prétendu ami. Lorsque la victime n'est plus en mesure de fournir des fonds supplémentaires, les prédateurs en ligne recourent au chantage et aux menaces, laissant généralement leurs victimes brisées financièrement et émotionnellement, ce qui entraîne des traumatismes pouvant aller jusqu’au suicide. Désormais, ces escrocs utilisent également l'intelligence artificielle pour générer des images et des vidéos qui semblent réelles et presque indétectables.

Luke Arrigoni, PDG de Loti AI, une startup spécialisée dans la défense numérique, notamment pour lutter contre les « deepfakes », a déclaré à Fox News Digital que les escroqueries impliquant l'utilisation d'images et de vidéos « deepfake » sont « de plus en plus courantes ».

Comment appréhender une vidéo d’un Deepfake généré par l’IA?

Comme tout ce qui est faux, les Deepfakes présentent plusieurs incohérences et vulnérabilités qui les distinguent de l'original.Cependant, les photos et vidéos Deepfake évoluent chaque jour, ce qui rend l’exercice de plus en plus difficile pour distinguer le vrai du faux.

A ce jour, l’appréciation et la détection d’une photo/vidéo Deepfake peut se porter sur la haute définition et les détails du visage, des yeux avec ou sans clignement. Le teint de la peau peut avoir une saturation avec des arrières plans flous. Les expressions faciales peuvent être déformées et pas coordonnées sur les lèvres ainsi que sur la voix. Les mains et les doigts peuvent être déformés et les ombres ou l'éclairage peuvent être déformés. La forme de l'oreille peut changer d'une image à l'autre, l'IA s'efforçant de maintenir une certaine cohérence. Les bijoux tels que les lunettes, les boucles d'oreilles ou d'autres accessoires peuvent vaciller ou apparaître difformes. Les mouvements et le langage corporel peuvent également être saccadés, robotiques ou rigides. Les membres peuvent être disproportionné par rapport au corps de l’individu. Le son et les bruits de fond ne sont généralement audibles et la voix est quelque peu robotique, avec des décalages et des accents ou intonations peu naturels. L'audio peut être légèrement décalé par rapport à la vidéo, ce qui se traduit par des mouvements de lèvres peu naturels et une mauvaise synchronisation audio. Une grande disparité entre la voix et les mouvements du corps peut également indiquer un Deepfake.

Quels sont les outils de détection des Deepfakes?

L'examen minutieux de chaque image de la vidéo et la recherche des indicateurs ci-dessus peuvent révéler des anomalies.

L’utilisation des outils tels que FotoForensics pour rechercher des incohérences dans les métadonnées du fichier est un moyen efficace.

La recherche d'images inversées via Google Lens ou de TinEye peut également aider à déterminer si l'image originale clonée apparaît ailleurs.

Des logiciels de détection d'IA peuvent aider à signaler les Deepfakes comme "Le Deepware Scanner", le "Microsoft Video Authenticator" ou "le Sensity AI".

Charity Ani KOSISOHUKWU