Le pape François en doudoune géante dans la rue, Vladimir Poutine agenouillé devant le président chinois… Vous avez sûrement déjà vu quelques unes de ces images improbables sur les réseaux sociaux ! Ces visuels, plus vrais que nature, sont en réalité générés très facilement par des sites accessibles au grand public. MidJourney, Dall-E 2 et Stable Diffusion sont les plus connus. Ils utilisent l’apprentissage automatique pour réaliser des images à partir de la multitude de données disponibles sur Internet.

Cette aptitude de création et de reproduction du réel provoque bien souvent de la confusion chez les internautes. S’il n’est pas toujours possible de distinguer clairement un produit généré d’une photo réelle, des astuces permettent encore d’y voir un peu plus clair.

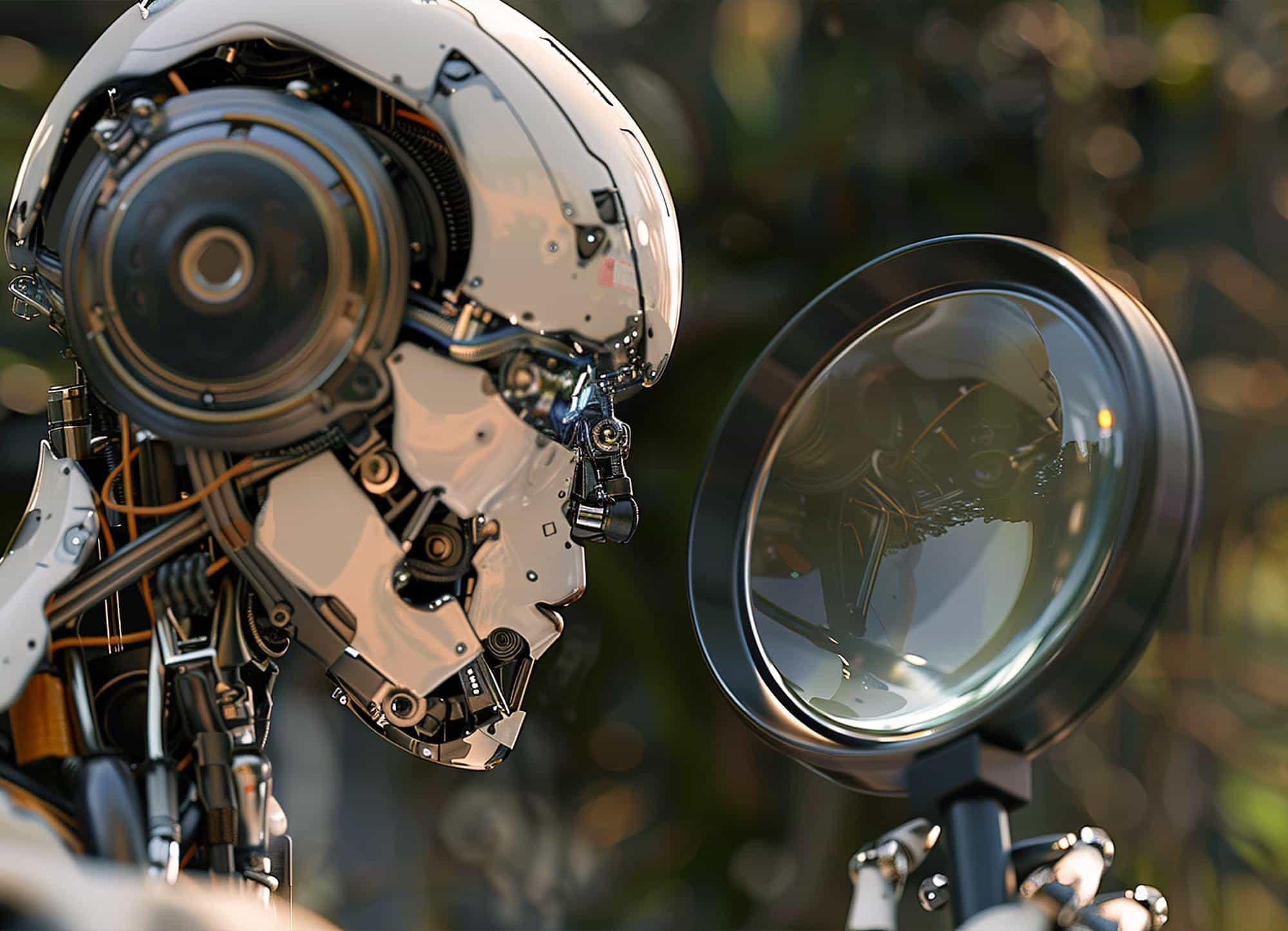

La technologie de l'IA ou pas ? Voilà quelques conseils pour vous aider !

Suivre l’actualité 📰

Certaines images surprenantes ne font sens qu’une fois remises dans leur contexte. Questionnez-vous. Dans quel contexte ce que je vois s’inscrit ?

En novembre 2018, l’ancien président gabonais Ali Bongo Ondima disparaît des radars pendant plusieurs semaines. Dans le pays, des rumeurs de son décès circulent.

Hospitalisé le 24 octobre en Arabie Saoudite suite à un AVC, Ali Bongo réapparaît à la télé le 31 décembre, une partie de son visage paralysé. Suite aux spéculations, beaucoup de Gabonais ont alors cru à une vidéo deepfake, générée par IA.

Vérifier que ce n’est pas indiqué ✅

Grâce au « watermarking », en anglais : un logo discret ou un filigrane peut apparaître directement sur l’image. Une mention peut également le préciser dans la légende ou description de celle-ci.

Dénicher les détails qui ne collent pas et développer son esprit critique 🧠

Lorsqu’elle créée des images, l’IA générative a des difficultés avec certains détails visuels. Elle provoque parfois des incohérences, visibles à l’œil nu !

Doigts en plus, membres en moins, visages flous et autres anomalies… Au sein d’une image, un élément sur un corps peut sortir partiellement déformé ou de manière bizarre. Dans un futur proche, l’IA, ne réalisera plus ces erreurs.

Remonter à la source de l’image 🖼️

Dans le doute, n’hésitez pas à réaliser une recherche d’image inversée pour retrouver toute trace de votre produit sur le net. Les outils d’IA générative utilisent majoritairement des bases de données publiques !

Utiliser l’IA contre l’IA

Cette technologie se perfectionne rapidement. Il est possible que dans un temps proche, les défauts de conception de ses images et vidéos ne soient plus perceptibles à l’œil nu. Retouchées, elles peuvent déjà paraître très crédibles et, donc, être manipulées à des fins de désinformation.

Fort heureusement, des outils se développent déjà pour détecter ces contenus et proposer un début de solution. C’est le cas de SynthID, lancé en septembre 2023 par Google. Encore en version bêta, la plateforme reste pour l’heure inaccessible au grand public.